Qualité des données financières : pourquoi les mauvaises données mènent aux mauvaises décisions

Date de publication :

06.04.2026

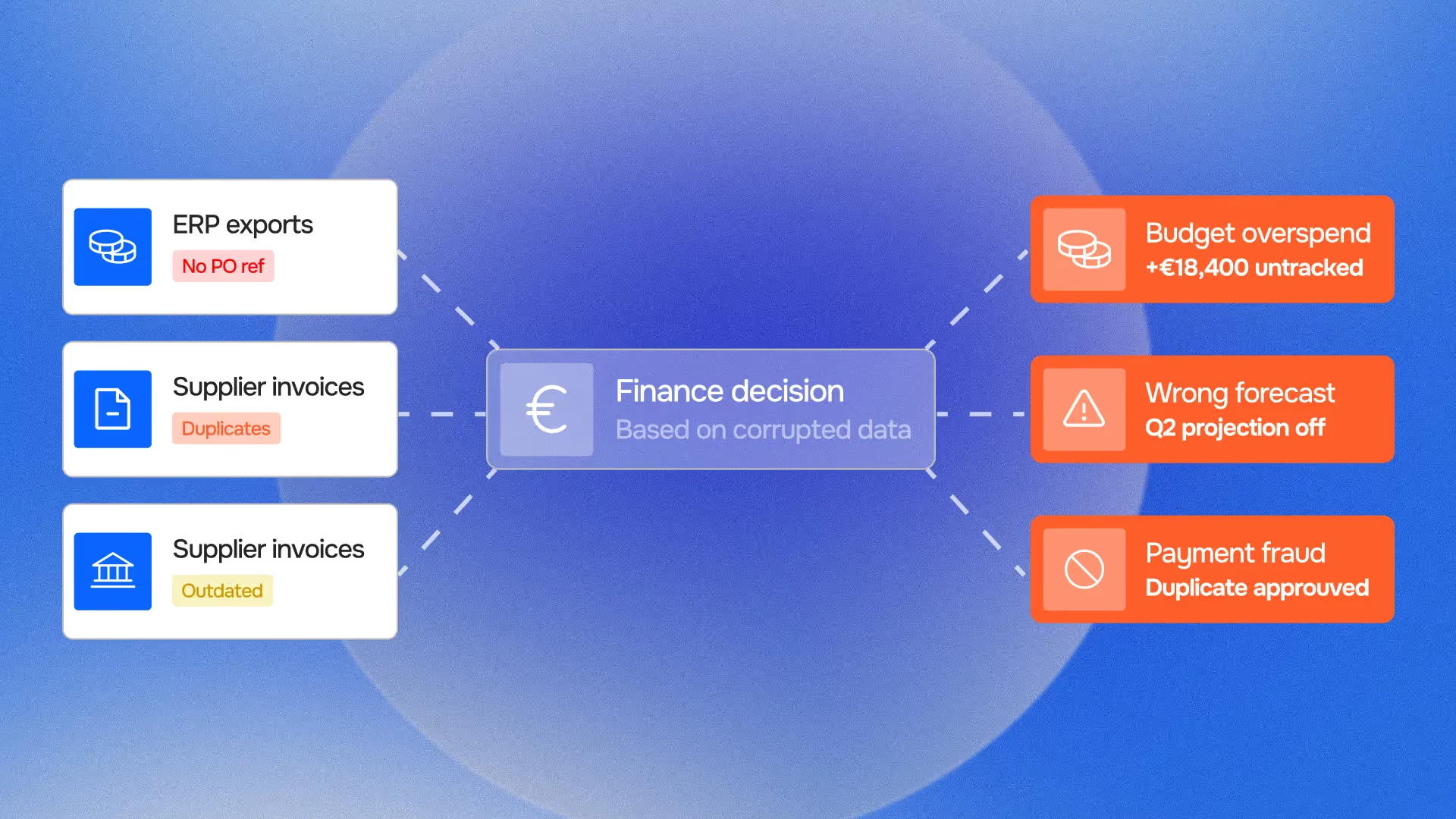

Les erreurs financières qui se remarquent sont les erreurs de paiement. Une facture en doublon réglée. Un fournisseur facturé au mauvais tarif. Une note de frais remboursée à tort. Ces erreurs sont visibles, elles apparaissent dans les rapprochements, remontent lors des audits, émergent comme des écarts quand les chiffres sont finalement comparés.

Les erreurs financières qui ne se remarquent pas sont les erreurs de décision. Un ajustement tarifaire non effectué parce que les données de marge avaient trois semaines de retard. Une position de trésorerie surestimée en raison d'encaissements non rapprochés, conduisant un DAF à valider un engagement que l'entreprise n'était pas en mesure de financer confortablement. Un ARR présenté au board incluant des contrats résiliés qui stagnaient encore dans le système de facturation. Une renégociation fournisseur démarrée sur une base de données erronée parce que les achats étaient catégorisés de manière incohérente entre entités.

Ces erreurs n'apparaissent jamais dans un rapprochement. Elles ne laissent aucune exception dans un journal système. Ce sont simplement des décisions prises en confiance sur des données qui ne méritaient pas cette confiance, et leur coût est souvent bien plus élevé que les erreurs de paiement qui sont détectées et corrigées.

La mauvaise qualité des données financières n'est pas principalement un problème de reporting. C'est un problème de décision. Et le résoudre nécessite d'intervenir bien en amont de là où la plupart des fonctions finance regardent aujourd'hui.

Le coût caché des mauvaises données financières : les décisions, pas les écarts

Les équipes finance mesurent les problèmes de qualité des données par leurs symptômes opérationnels : taux d'exceptions, backlog de rapprochement, temps de préparation de la clôture. Ce sont des coûts réels, mais ils ne sont pas les plus importants liés à la mauvaise qualité des données financières.

Les coûts les plus importants sont dans les décisions prises sur des données qui semblaient fiables, mais ne l'étaient pas.

Un DAF qui se fie à un chiffre d'ARR qui n'a pas été rapproché des transactions de facturation prend des décisions d'allocation du capital sur une estimation présentée comme un fait. Un directeur achats qui approuve un renouvellement de contrat fournisseur en se basant sur une analyse des dépenses n'ayant pas normalisé les libellés de catégories entre entités négocie depuis une position qui ne représente pas fidèlement son vrai volume d'achats. Un board qui examine une prévision de trésorerie construite sur des soldes bancaires non vérifiés peut approuver ou rejeter des investissements sur la base d'une position qui diffère de la réalité de plusieurs jours ou semaines de transactions non rapprochées.

Aucun de ces décideurs n'est négligent. Ils travaillent avec les données à leur disposition, présentées via les systèmes et processus que leur organisation a construits. Le problème n'est pas la décision, c'est que l'infrastructure de qualité des données nécessaire pour prendre la décision correctement n'était pas en place.

La fiabilité et crédibilité des données, la propriété des données financières qui permet de s'y fier pour des décisions à tout moment, n'est pas une caractéristique technique. C'est une posture organisationnelle : l'ensemble des processus, contrôles et couches de validation qui s'interposent entre la donnée financière brute et les décisions qu'elle alimente.

Quand cette posture est faible, les conséquences n'apparaissent pas dans les files d'exceptions, elles apparaissent dans les résultats des décisions.

Cinq façons dont la mauvaise qualité des données financières corrompt les décisions

1. Des données obsolètes présentées comme actuelles

Les données financières ont une fenêtre de validité. Un solde bancaire est exact au moment où le relevé a été généré, et devient progressivement moins exact au fur et à mesure que les transactions sont comptabilisées, réglées et enregistrées avec des délais variables entre systèmes connectés. Un chiffre de revenus est exact au moment où le cycle de facturation s'est clôturé, et diverge de la réalité au fur et à mesure que les paiements clients arrivent, que les contrats sont modifiés et que les événements de reconnaissance se produisent.

Quand des données obsolètes sont présentées comme actuelles, sans horodatage, sans date de rapprochement, sans indicateur de la dernière validation, le décideur n'a aucun mécanisme pour appliquer un scepticisme approprié. Le chiffre sur le tableau de bord semble actuel parce que le tableau de bord a été rafraîchi ce matin. Les données sous-jacentes peuvent ne pas avoir changé depuis mercredi dernier.

Les décisions basées sur des données financières obsolètes portent des erreurs systématiques dans des directions prévisibles : les positions de trésorerie tendent à être surestimées (parce que les sorties non rapprochées n'ont pas encore réduit le solde), les créances clients tendent à être surestimées (parce que l'analyse de l'antériorité n'a pas capturé les paiements récents), et les chiffres de revenus tendent à accuser un retard sur la réalité dans les deux sens selon le timing du cycle de reconnaissance.

La discipline du contrôle financier continu adresse cela spécifiquement : en rapprochant les données financières en continu plutôt que périodiquement, l'écart entre "données telles qu'affichées sur le tableau de bord" et "données telles qu'elles sont maintenant" se mesure en heures plutôt qu'en jours ou semaines. Mais le rapprochement continu n'est qu'une partie de la réponse, la donnée doit aussi porter sa provenance : quand a-t-elle été validée pour la dernière fois, contre quelle source, et avec quel niveau de confiance.

2. Des catégorisations incohérentes entre systèmes ou entités

Toute organisation qui opère sur plusieurs systèmes, entités ou dimensions de reporting fait face à un problème de cohérence des catégorisations. Le même fournisseur peut être classifié sous "logistique" dans une entité et "opérations" dans une autre. Le même type de coût peut apparaître comme "dépenses marketing" dans le compte de résultat issu du CRM et "développement commercial" dans l'ERP. La même ligne de produit peut être étiquetée avec des libellés de catégories de revenus différents selon que la source est le système de facturation ou le système comptable.

Quand un DAF ou un contrôleur de gestion agrège ces données pour un rapport de gestion ou un board pack, il travaille avec une couche de catégorisation qui semble cohérente (le rapport a des lignes et des colonnes propres) mais est construite sur une incohérence sous-jacente. Le tableau "dépenses marketing par région" compare peut-être des régions qui ont classifié les coûts différemment, produisant une comparaison arithmétiquement correcte mais économiquement sans signification.

Les décisions qui découlent de cette analyse, réallocations budgétaires, décisions de recrutement, ajustements tarifaires, sont basées sur une comparaison qui ne représente pas fidèlement la réalité commerciale sous-jacente. L'erreur n'est pas dans l'arithmétique. Elle est dans l'hypothèse fausse que des catégories portant le même libellé contiennent des transactions similaires.

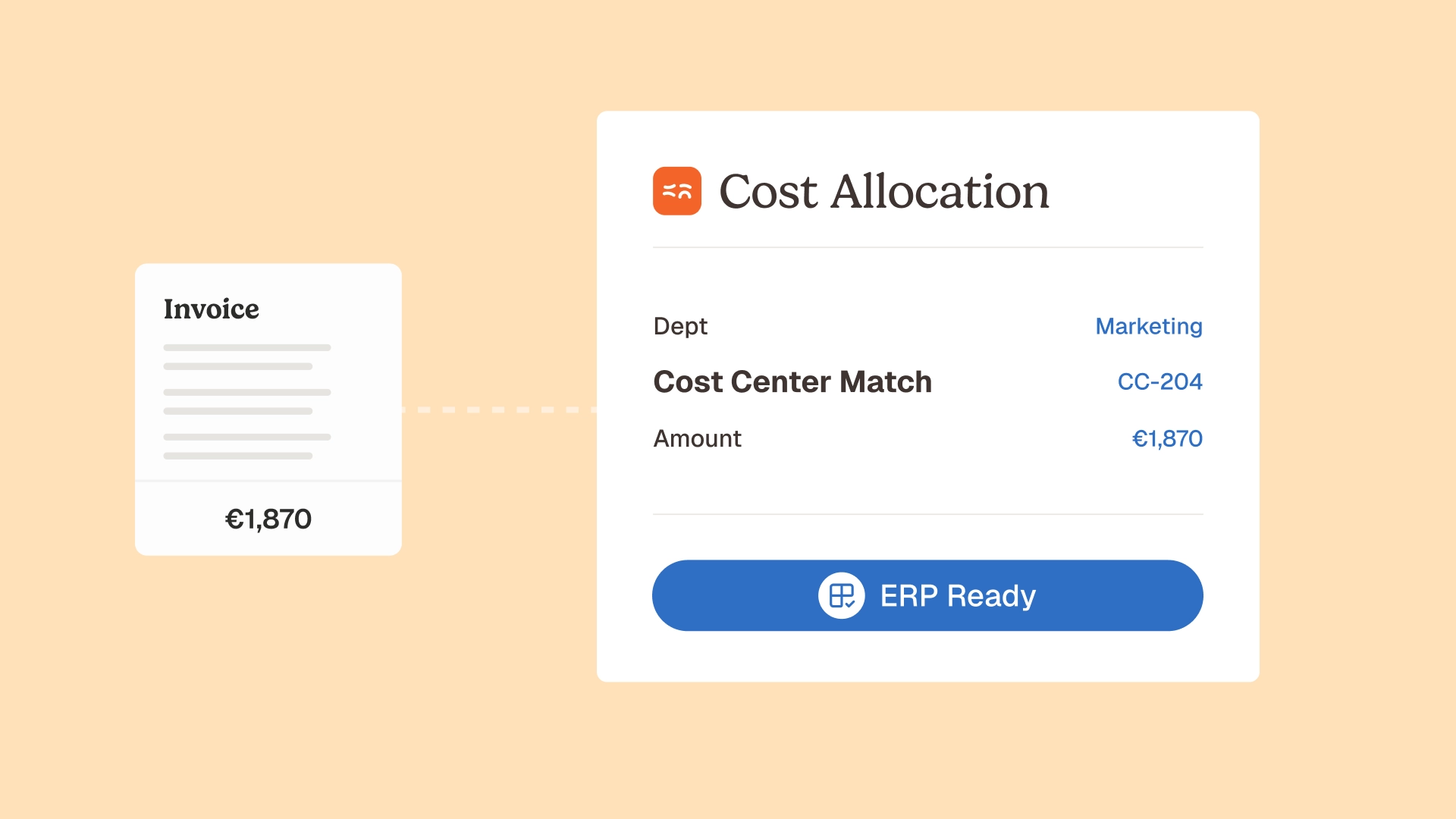

La normalisation des données et la labellisation des données appliquées de manière cohérente à travers tous les systèmes sources, pas seulement au sein d'un seul système, sont le prérequis d'un reporting de gestion capable de supporter des comparaisons inter-entités. L'agent de standardisation et recatégorisation des écritures comptables de Phacet applique cette couche de normalisation à travers les sources de données connectées, s'assurant que les libellés de catégories portent un sens économique cohérent sur toute la population de reporting.

3. Des erreurs non détectées qui s'accumulent en inexactitudes matérielles

Les erreurs individuelles de qualité des données sont rarement matérielles seules. Une facture traitée à un prix 3 % au-dessus du tarif contractuel n'est pas une erreur matérielle d'états financiers. Mais dans une organisation traitant 2 000 factures par mois de fournisseurs avec des accords tarifaires complexes, un écart tarifaire systématique de 3 % sur un sous-ensemble de ces factures peut représenter des centaines de milliers d'euros annuellement, suffisamment pour affecter matériellement le reporting de marge et les décisions de gestion qui s'y fondent.

Le problème n'est pas l'existence d'erreurs individuelles. C'est l'absence d'un mécanisme de détection qui identifie quand des erreurs individuelles font partie d'un schéma systématique. Les contrôles basés sur l'échantillonnage, la revue mensuelle d'une sélection représentative de factures, peuvent détecter des erreurs individuelles mais ne peuvent pas identifier des schémas systématiques à moins que l'échantillon ne soit conçu pour les faire remonter.

Les contrôles de qualité des données basés sur les schémas, appliqués en continu sur toute la population de transactions, peuvent identifier des déviations systématiques qu'une revue individuelle de transactions manquerait : un fournisseur spécifique facturant systématiquement au-dessus des tarifs contractuels, une catégorie de coût spécifique avec une distribution anormale des montants, une entité spécifique avec un taux de rapprochement qui diverge des autres. Ces schémas sont des signaux de qualité des données, ils indiquent que la population de données sous-jacente a un problème de qualité systématique qui produira des erreurs cohérentes dans toute décision qui s'y fie.

L'exposition au risque financier intégrée dans les erreurs systématiques non détectées est la raison principale pour laquelle la qualité des données financières compte au-delà de l'efficacité opérationnelle. Il ne s'agit pas de détecter des erreurs individuelles, il s'agit de s'assurer que la population de données alimentant les décisions stratégiques ne contient pas de biais systématiques qui produiront des résultats systématiquement erronés.

4. Des incohérences cross-systèmes confondues avec la réalité

Les fonctions finance modernes opèrent sur une stack de systèmes qui détiennent chacun une version partielle de la réalité financière : l'ERP détient l'enregistrement comptable, le CRM détient le pipeline commercial, la plateforme de facturation détient l'enregistrement des transactions de revenus, le portail bancaire détient la position de trésorerie. Chaque système est cohérent en interne. Aucun ne détient la même version de la réalité financière.

Quand un décideur pose une question qui couvre ces systèmes, "quel est notre chiffre d'affaires net actuel du segment client X ?", la réponse dépend du système interrogé. L'ERP donnera une réponse comptable basée sur les revenus facturés et reconnus. Le CRM donnera une réponse basée sur le pipeline incluant les revenus contractualisés mais pas encore facturés. La plateforme de facturation donnera une réponse transactionnelle basée sur les montants facturés indépendamment de la reconnaissance. Le portail bancaire donnera une réponse de trésorerie basée sur les encaissements réels.

Les quatre réponses sont correctes en interne. Aucune n'est le même chiffre. Si le décideur ne sait pas quel système privilégier pour quelle question, il obtiendra une réponse, mais pas nécessairement la bonne pour la décision à prendre.

La validation de la source de vérité et l'alignement des données multi-systèmes adressent cela en établissant quel système fait autorité pour chaque type de données et en rapprochant les valeurs cross-systèmes de manière systématique. La couche de préparation de données prêtes à la décision dans l'architecture Phacet effectue ce rapprochement avant que les données n'atteignent tout workflow de reporting ou d'analyse, s'assurant que le chiffre présenté pour une décision reflète une vue cohérente et validée cross-systèmes plutôt que la sortie de n'importe quel système interrogé en premier.

5. Des données manquantes qui imposent une fausse confiance

Les décisions financières sont prises dans l'incertitude. Le professionnel finance expérimenté gère cela en sachant quelles parties des données sont solides et lesquelles sont des estimations, quels chiffres sont validés par les systèmes et lesquels sont compilés manuellement, quels nombres portent des intervalles de confiance étroits et lesquels portent des intervalles larges.

Cette calibration dépend entièrement de la traçabilité des données : la capacité à remonter un chiffre jusqu'à sa source, le processus qui l'a produit et les contrôles qui l'ont validé. Quand la traçabilité des données est faible, quand un chiffre apparaît dans un rapport sans piste claire vers sa source, le décideur n'a aucun mécanisme pour distinguer les données à haute confiance des données à faible confiance. Il doit soit traiter toutes les données comme également fiables (ce qui sous-estime l'incertitude pour les chiffres à faible confiance), soit traiter toutes les données comme également incertaines (ce qui surestime l'incertitude pour les chiffres à haute confiance).

Les deux erreurs produisent des problèmes de qualité décisionnelle. Traiter des données à faible confiance comme fiables produit des décisions trop confiantes. Traiter des données à haute confiance comme incertaines produit des décisions excessivement prudentes ou une paralysie décisionnelle.

Le contrôle décisionnel explicable et auditable, le principe que chaque donnée alimentant une décision financière devrait être traçable jusqu'à sa source, le processus qui l'a produite et la validation appliquée, est ce qui permet une calibration appropriée. Ce n'est pas seulement une exigence d'audit. C'est une exigence de qualité décisionnelle : le décideur qui connaît le niveau de confiance de ses données prend de meilleures décisions que celui qui ne le connaît pas.

Pourquoi la qualité des données financières se dégrade systématiquement

Comprendre pourquoi la qualité des données financières se dégrade aide à identifier où intervenir. Les causes sont structurelles plutôt que comportementales, elles ne découlent pas de la négligence mais de l'architecture des opérations finance modernes.

La prolifération multi-systèmes sans synchronisation.

Chaque nouveau système ajouté à la stack technologique finance crée une nouvelle source potentielle d'incohérence. Deux systèmes qui détenaient autrefois les mêmes données commencent à diverger dès l'instant où ils se mettent à jour indépendamment. Sans une discipline systématique de synchronisation et de rapprochement, cette divergence se compose dans le temps, silencieusement, sans aucun message d'erreur.

La manipulation manuelle des données aux points d'intégration.

Les données qui circulent entre systèmes via des exports manuels, des opérations copier-coller ou une ressaisie humaine sont des données qui peuvent être modifiées, corrompues ou perdues à chaque point de passage. La plupart des fonctions finance ont plus de ces points d'intégration manuels qu'elles ne le réalisent, souvent créés comme solutions de contournement pour des systèmes qui ne s'intègrent pas nativement. Chacun est un risque de qualité des données invisible jusqu'à ce qu'il produise une erreur.

La dérive de catégorisation dans le temps.

Les schémas de classification qui commencent cohérents deviennent incohérents au fur et à mesure que de nouveaux types de transactions, de nouveaux fournisseurs et de nouvelles catégories de coûts sont ajoutés sans mettre à jour la logique de classification sous-jacente. La catégorie "divers" grossit. La frontière entre catégories adjacentes s'estompe. Les comparaisons historiques deviennent peu fiables car le même libellé vient à désigner des choses différentes selon les périodes.

Les contrôles basés sur l'échantillonnage qui manquent les problèmes systématiques.

Comme décrit ci-dessus, le contrôle mensuel par échantillon détecte les erreurs individuelles mais manque les schémas. La dégradation systématique de la qualité qui produit des erreurs dans les décisions de gestion se manifeste typiquement comme un schéma, une déviation cohérente, une dérive dans une direction, que l'échantillonnage par transactions individuelles est conçu à manquer.

L'absence d'une boucle de feedback sur la qualité des données.

La plupart des fonctions finance ont des processus pour détecter les erreurs de qualité des données quand elles causent un problème visible (un rapprochement échoue, une observation d'audit est soulevée). Très peu ont des processus pour mesurer la qualité des données de manière proactive, monitorer le taux d'exactitude des données financières sur toute la population, suivre le taux auquel les valeurs cross-systèmes divergent, mesurer l'âge des données alimentant les workflows de décision. Sans cette mesure, la dégradation de la qualité des données est invisible jusqu'à ce qu'elle produise une erreur matérielle.

Les 5 dimensions de la qualité des données financières

La qualité des données financières est multidimensionnelle. L'améliorer nécessite d'adresser les cinq dimensions, améliorer l'une en négligeant les autres produit des résultats partiels qui laissent encore la prise de décision exposée.

L'exactitude : la donnée représente-t-elle correctement l'événement économique sous-jacent ? Une facture enregistrée au mauvais montant, un encaissement mal imputé au mauvais compte, une conversion de devise appliquée au mauvais taux : toutes sont des défaillances d'exactitude. Les contrôles d'exactitude sont les plus communément déployés, c'est ce que ciblent la plupart des processus de contrôle AP et de rapprochement. Mais l'exactitude seule n'est pas suffisante.

La complétude : la donnée inclut-elle tous les événements pertinents ? Un compte de résultat qui ne capture pas tous les centres de coûts, un rapport de créances manquant des factures non encore comptabilisées dans le cycle de facturation, un tableau des flux de trésorerie construit sur des données bancaires n'ayant pas capturé les transactions du dernier jour : toutes sont des défaillances de complétude. Les défaillances de complétude produisent des erreurs de sous-estimation, la donnée est exacte pour ce qu'elle montre, mais elle ne montre pas tout.

La cohérence : la donnée représente-t-elle les mêmes choses de la même façon entre systèmes, entités et périodes ? Le problème de cohérence des catégorisations décrit ci-dessus est une défaillance de cohérence. De même qu'une définition de métrique qui change entre périodes de reporting sans retraiter les chiffres historiques. Les défaillances de cohérence produisent des erreurs de comparaison, la donnée est exacte isolément mais produit des conclusions trompeuses lors de la comparaison.

La temporalité : la donnée reflète-t-elle l'état actuel de la réalité économique sous-jacente ? Des données obsolètes présentées comme actuelles sont une défaillance de temporalité. De même qu'un rapprochement mensuel dans une entreprise où les transactions se règlent quotidiennement. La fiabilité et crédibilité des données exige que les données ne soient pas seulement exactes au moment de la validation mais restent exactes (ou soient re-validées) au point d'utilisation.

La traçabilité : chaque donnée peut-elle être remontée jusqu'à sa source, le processus qui l'a produite et les contrôles appliqués ? La traçabilité est la dimension qui permet de vérifier toutes les autres. Sans elle, l'exactitude, la complétude, la cohérence et la temporalité sont affirmées plutôt que démontrées. La piste d'audit que les agents Phacet génèrent pour chaque transaction traitée adresse la dimension de traçabilité : chaque chiffre qui atteint un workflow de décision porte un enregistrement de provenance montrant exactement comment il a été produit et validé.

De l'hygiène des données à une infrastructure de données prêtes à la décision

La plupart des fonctions finance ont quelques pratiques de qualité des données en place. Elles font des rapprochements de fin de mois. Elles ont un workflow d'approbation AP. Elles produisent des rapports d'exceptions. Ces pratiques adressent la qualité des données de manière réactive, détectant les erreurs après qu'elles ont pénétré le pipeline de données, et sur un échantillon plutôt que sur la population totale.

Le passage de l'hygiène des données à une infrastructure de données prêtes à la décision nécessite trois changements :

Du réactif au préventif.

Les contrôles de qualité des données appliqués avant qu'une transaction entre dans l'enregistrement financier sont plus efficaces qu'appliqués après, à la fois parce qu'ils empêchent l'erreur de se propager à travers les systèmes en aval et parce que le contexte pour la correction est encore disponible. Les contrôles avant paiement et les couches de contrôle avant décision sont préventifs par conception. Notre analyse du contrôle financier continu couvre le glissement architectural du périodique au continu en détail.

De l'échantillon à la population.

Les contrôles appliqués à un échantillon de transactions laissent des problèmes de qualité systématiques non détectés. Les contrôles alimentés par l'IA appliqués à chaque transaction font remonter des schémas que l'échantillonnage manque, la déviation tarifaire cohérente chez un fournisseur, la dérive de catégorisation, la divergence cross-systèmes individuellement petite mais cumulativement matérielle. Le modèle de revue financière par exception rend ce contrôle au niveau de la population opérationnellement viable : chaque transaction est vérifiée, les véritables exceptions sont routées pour une revue humaine, et l'attention de l'équipe finance se concentre sur les exceptions qui le nécessitent réellement.

Du systémique au cross-systémique.

Les contrôles de qualité des données appliqués au sein d'un seul système n'adressent pas les incohérences cross-systèmes qui produisent les erreurs de décision les plus dommageables. Le rapprochement financier entre systèmes, comparer la vue ERP à la vue de la plateforme de facturation, à la vue bancaire, à la vue CRM, est le contrôle qui détecte les erreurs que les contrôles systèmes individuels manquent. Les agents de rapprochement Phacet appliquent cette logique cross-systèmes en continu, produisant une vue de données unifiée et validée portant une provenance cohérente à travers toutes les sources connectées. L'article sur le rapprochement des données financières couvre les pratiques spécifiques en détail.

Questions fréquentes

Qu'est-ce que la qualité des données financières et pourquoi compte-t-elle pour les décisions ?

La qualité des données financières est le degré auquel les données financières représentent fidèlement, exhaustivement, cohéremment et de manière traçable la réalité économique sous-jacente qu'elles sont censées capturer. Elle compte pour les décisions parce que chaque décision financière, approbation de paiement, allocation budgétaire, ajustement tarifaire, engagement d'investissement, est implicitement un pari que les données sur lesquelles elle se fonde sont fiables. Quand ces données sont inexactes, incomplètes, catégorisées de manière incohérente, obsolètes ou non traçables, la décision porte une erreur systématique invisible pour le décideur. Le coût de la mauvaise qualité des données financières n'est pas principalement les erreurs qu'elle introduit dans les rapports, c'est les erreurs qu'elle introduit dans les décisions.

Quelle est la différence entre qualité des données financières et exactitude du reporting financier ?

L'exactitude du reporting financier concerne le fait que les états financiers publiés représentent correctement la situation financière de l'entreprise. La qualité des données financières est plus large : elle englobe l'exactitude, la complétude, la cohérence, la temporalité et la traçabilité de l'ensemble des données qui alimentent les décisions financières, y compris les décisions opérationnelles prises en cours de période, pas seulement les états financiers périodiques. Une entreprise peut avoir des états financiers techniquement exacts (parce que les erreurs s'annulent ou restent sous les seuils de matérialité) tout en ayant une mauvaise qualité de données financières qui corrompt systématiquement les décisions prises en cours de période.

Quelles sont les causes les plus fréquentes de mauvaise qualité des données financières ?

Les causes structurelles les plus fréquentes sont : la prolifération multi-systèmes sans synchronisation systématique (chaque nouveau système crée un nouveau point de divergence), la manipulation manuelle des données aux points d'intégration (exports, ressaisies, copier-coller qui introduisent des erreurs et perdent la provenance), la dérive de catégorisation dans le temps (logique de classification devenant incohérente au fur et à mesure que de nouveaux types de transactions sont ajoutés sans mettre à jour le schéma sous-jacent), les contrôles basés sur l'échantillonnage qui manquent les schémas systématiques, et l'absence de mesure proactive de la qualité des données (les problèmes ne sont visibles que lorsqu'ils causent une erreur, pas pendant qu'ils se développent).

Comment la mauvaise qualité des données financières affecte-t-elle le processus de clôture ?

La mauvaise qualité des données financières allonge directement le cycle de clôture. Les éléments de rapprochement qui s'accumulent quand la qualité des données cross-systèmes est faible constituent la charge de travail primaire de la clôture : rapprocher les transactions bancaires non rapprochées avec les enregistrements ERP, résoudre les écarts de factures, traiter les incohérences de catégorisation qui empêchent la comptabilisation automatique. Les fonctions finance dotées de contrôles de qualité des données continus robustes signalent systématiquement des réductions de 40 à 60 % du temps de préparation de la clôture, non pas parce que le processus de clôture a changé, mais parce que les problèmes de qualité des données qui s'accumulaient pendant la période sont résolus en continu plutôt que reportés à la clôture.

Qu'est-ce qu'une donnée "prête à la décision" et en quoi diffère-t-elle d'une donnée propre ?

Une donnée propre est une donnée sans erreurs, exacte, complète et correctement formatée. Une donnée prête à la décision est une donnée propre qui porte également la provenance, la validation de temporalité et les vérifications de cohérence cross-systèmes qui permettent à un décideur de s'y fier sans vérification supplémentaire. Une base de données avec des enregistrements propres mais sans horodatages, sans historique de rapprochement et sans traçabilité jusqu'aux documents sources est propre mais pas prête à la décision. Les données prêtes à la décision peuvent être fiables au point d'utilisation parce qu'elles portent la preuve des contrôles qui les ont validées, pas seulement l'absence d'erreurs détectables.

Comment les agents IA améliorent-ils la qualité des données financières par rapport aux processus manuels ?

Les processus manuels de qualité des données sont bornés par la capacité humaine, une équipe peut vérifier un échantillon de transactions, maintenir la cohérence au sein d'un seul système et répondre aux erreurs après qu'elles ont été signalées. Les agents IA améliorent cela de trois façons : ils traitent chaque transaction plutôt qu'un échantillon, ils appliquent une logique de validation cohérente sans la variation qui vient de jugements différents entre analystes, et ils détectent des schémas sur toute la population de données que les revues par échantillon manqueraient. Les agents d'extraction intelligente de données que Phacet déploie appliquent également la normalisation et la résolution d'entités au point d'ingestion, empêchant les incohérences de format et de classification qui dégradent la qualité des données avant qu'elles n'entrent dans l'enregistrement financier.

Par où une fonction finance doit-elle commencer pour adresser les problèmes de qualité des données ?

Commencer par les données qui alimentent les décisions à enjeux les plus élevés, pas par le plus grand volume de transactions. Pour la plupart des organisations, cela signifie : les données de revenus et d'ARR alimentant le reporting investisseur (parce que les erreurs ici ont les conséquences externes les plus importantes), les données de factures fournisseurs et de paiements alimentant la gestion de la trésorerie et des marges (parce que les erreurs ici ont l'impact financier le plus direct), et les données de coûts cross-entités alimentant les décisions d'allocation de ressources (parce que les erreurs ici produisent les décisions de gestion les plus systématiquement erronées). Pour chaque domaine, la première étape est la mesure : quel est le taux de rapprochement cross-systèmes actuel, quel est le taux d'erreur dans la population totale de transactions (pas l'échantillon), et quel est l'âge des données au moment où elles alimentent les workflows de décision ?

Les mauvaises données n'annoncent pas leur arrivée avant une décision

Le défi fondamental de la mauvaise qualité des données financières est son invisibilité. Une erreur de paiement s'annonce, éventuellement, dans un rapprochement, un audit ou un litige fournisseur. Une erreur de décision prise sur de mauvaises données ne s'annonce presque jamais. La décision de recrutement qui aurait dû être différée parce que la trésorerie était plus tendue que le tableau de bord ne le montrait. L'objectif de marge fixé trop généreusement parce que les données d'écarts tarifaires fournisseurs n'étaient pas capturées. L'acquisition valorisée à une prime sur un chiffre d'ARR qui n'avait pas été rapproché.

Ces décisions n'échouent pas spectaculairement. Elles n'atteignent simplement pas les résultats que de meilleures données auraient permis, et le lien causal entre le problème de qualité des données et le résultat de la décision n'est jamais établi parce que personne ne le cherche.

La fonction finance qui résout la qualité des données financières ne résout pas qu'un problème opérationnel. Elle résout un problème de qualité décisionnelle, à travers toutes les parties de l'organisation qui utilisent des données financières pour prendre des décisions, c'est-à-dire toutes les parties de l'organisation.

L'infrastructure de qualité des données de Phacet applique les cinq dimensions, exactitude, complétude, cohérence, temporalité et traçabilité, sur toute la population de transactions, en continu, avec une validation cross-systèmes et un enregistrement de provenance complet pour chaque donnée. L'agent de traitement de la boîte mail comptable, l'agent de rapprochement bancaire, l'agent de contrôle de la facturation fournisseur et l'agent de labellisation des flux de trésorerie contribuent chacun à cette infrastructure, couvrant les domaines de données où les erreurs de décision portent le coût financier le plus élevé. Réservez une démo pour voir comment la couche de qualité des données Phacet s'applique à votre environnement financier et ce que vos données actuelles révèlent sur la concentration du risque décisionnel.

Dernières ressources

Débloquez votre potentiel avec l'IA

Exploitez davantage vos ressources existantes grâce à des solutions d'IA personnalisées.